Uma publicação na plataforma X (antigo Twitter) da conta Zap Actu GTA 6 soa o alarme:

“SITUAÇÃO EXTREMAMENTE GRAVE”.

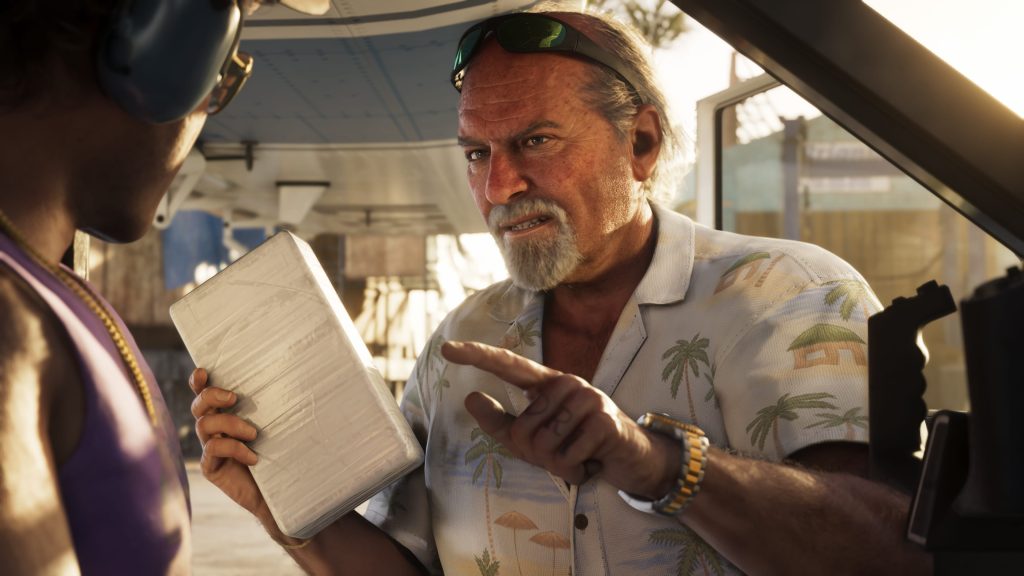

A alegação é a existência de um suposto vídeo de gameplay do aguardadíssimo GTA 6, da Rockstar Games. Se autêntico, mesmo sendo breve, o vídeo representaria um vazamento de informações de grande impacto.

Entretanto, a realidade é bem diferente. Não se trata de um vazamento genuíno, nem de gameplay real. O que vemos é mais um vídeo “vazado” de GTA 6, criado com o auxílio de inteligência artificial (IA). Esse tipo de conteúdo tem alcançado milhões de visualizações e permanece ativo nas redes sociais, que parecem incapazes de combatê-lo efetivamente, limitando-se a alertas esporádicos.

O tweet em questão, publicado recentemente, viralizou rapidamente, atingindo a marca de 8 milhões de visualizações em pouco mais de um dia. Embora uma nota da comunidade alerte sobre a falta de autenticidade, isso parece ter pouco efeito em sua disseminação. E este é apenas um exemplo entre muitos. A mesma conta no Twitter tem divulgado vídeos semelhantes nos últimos meses, alguns com grande alcance, numa tentativa clara de atrair seguidores e membros para seu servidor no Discord.

As reações indicam que muitos usuários do Twitter estão acreditando nesses vazamentos como verdadeiros. Esse é um problema que GTA 6 enfrenta há algum tempo, o que não surpreende, dada a expectativa e o desejo por informações sobre o que se espera ser um dos maiores lançamentos da história do entretenimento. Contudo, GTA 6 não está sozinho nessa situação, nem apenas o mundo dos videogames.

Outros casos envolvendo figuras públicas demonstram a amplitude do problema. Recentemente, o físico Brian Cox expressou sua indignação com canais no YouTube que utilizam IA para criar deepfakes dele, proferindo “absurdos” sobre um cometa. Keanu Reeves também criticou deepfakes de IA que o retratam vendendo produtos sem sua autorização, considerando a situação “nada divertida”. O ator chega a pagar uma empresa para remover vídeos feitos com IA que utilizam sua imagem em plataformas como TikTok e Meta.

Em 2023, Tom Hanks alertou seus fãs sobre o uso não autorizado de uma versão de IA com sua imagem em um anúncio online para um plano odontológico. No ano anterior, Morgan Freeman agradeceu aos fãs que o alertaram sobre imitações de sua voz geradas por IA, após a viralização de vídeos criados por alguém se passando por sua sobrinha. Jamie Lee Curtis também teve que apelar ao CEO da Meta, Mark Zuckerberg, para remover um anúncio gerado por IA que utilizava sua imagem para promover algo que ela não havia autorizado.

A questão central é: como solucionar esse problema? O YouTube planeja atualizar suas políticas para restringir a monetização de conteúdo “inautêntico”, produzido facilmente em larga escala com IA generativa. No entanto, uma rápida pesquisa na plataforma demonstra que essa medida ainda não surtiu o efeito desejado.

Sem uma legislação que exija a identificação clara de conteúdos criados por IA generativa ou que proíba deepfakes sem consentimento, os fãs continuarão sendo enganados. E, com o avanço da tecnologia, a distinção entre o real e o falso se torna cada vez mais difícil.

Alguma ação significativa pode ser tomada? Recentemente, o governo japonês solicitou formalmente à OpenAI que se abstivesse de infringir direitos autorais, após a geração de vídeos com personagens protegidos por direitos autorais de animes e videogames no Sora 2.

Enquanto isso, o perfil Zap Actu GTA6 continua publicando “vazamentos” falsos, aparentemente sem se preocupar com as possíveis consequências. No Discord, um novo membro questionou a atitude do perfil, considerando-a desrespeitosa com os fãs. Até o momento, ZapActu não respondeu.

Veja nosso post sobre GTA VI – Tudo o que sabemos até agora sobre o próximo grande lançamento da Rockstar

Fonte: